L'IA à l'école : ce qu'on ne vous dit pas vraiment.

J'ai voulu documenter ce truc bizarre qui se passe depuis 2020 concernant l'IA. Avec des chiffres, des témoignages et surtout : sans prendre parti pour ou contre l'IA.

L'IA à l'école se résume souvent à deux camps stériles : ceux qui veulent tout interdire « pour protéger les élèves », et ceux qui promettent une école augmentée par la techno, personnalisée, magique. Entre les deux, il y a surtout des profs et des étudiants qui naviguent à vue, sans cadre clair, avec beaucoup de non-dits.

Mon livre blanc part précisément de là : pas de fantasmes, pas de slogans, mais ce que vivent vraiment 545 personnes dans les salles de classe et les amphis. Et ce qu'ils racontent, c'est qu'on est en train de louper quelque chose d'essentiel.

Perso, j'ai appris plein de choses.

Et ça fait du bien.

L'IA n'est plus une expérimentation, c'est un angle mort

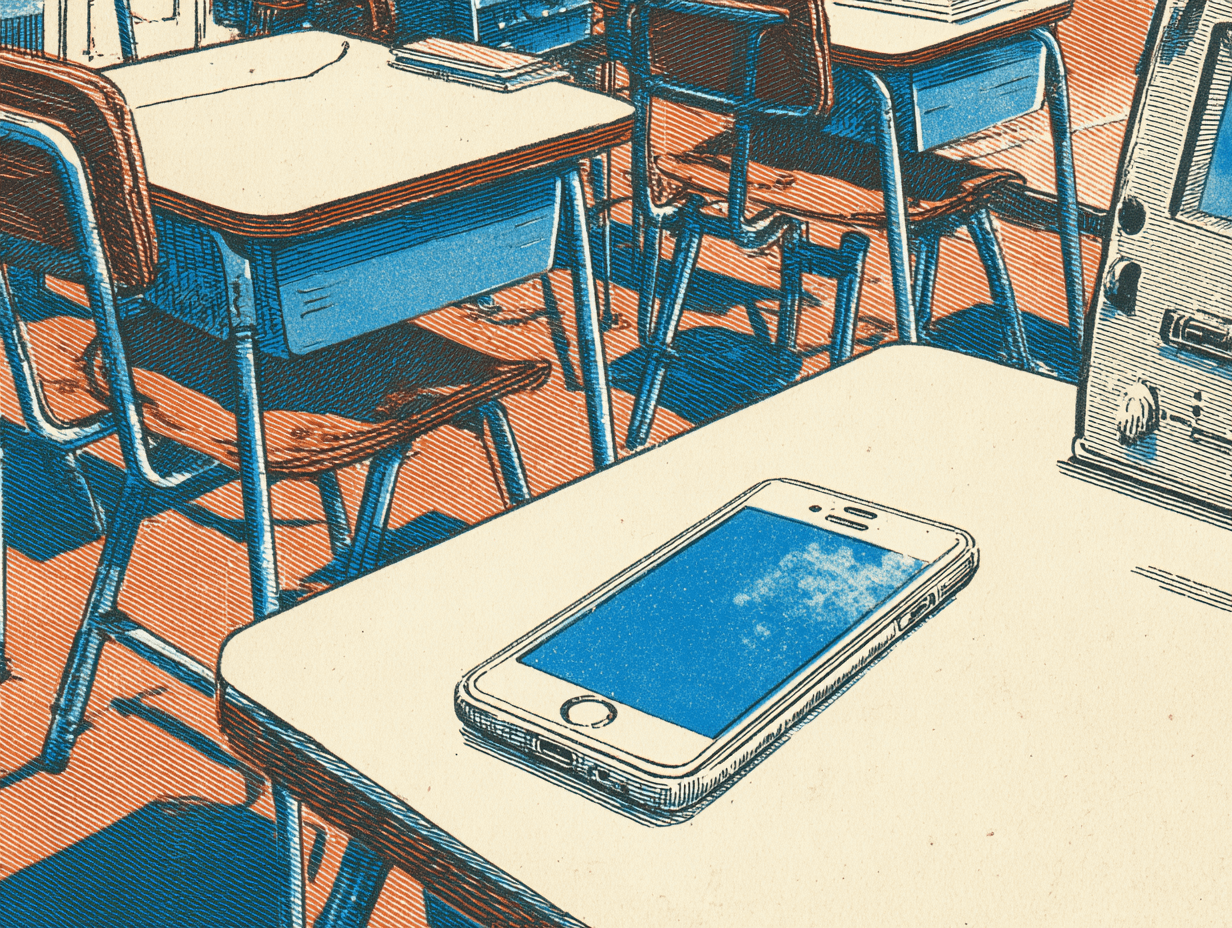

L'automne 2025 marque un point de bascule. L'IA générative n'est plus un gadget de geek ou un sujet de colloque. C'est un outil quotidien pour une majorité d'étudiants, souvent utilisé hors de tout cadre explicite. Les établissements publient des chartes, organisent des webinaires, communiquent sur leur « stratégie IA ». Pendant ce temps, dans les copies, les projets et les mémoires, il se passe autre chose.

Un décalage s'est installé. Pas un petit écart. Un fossé. Entre ce qui est écrit dans les politiques d'établissement et ce qui se joue réellement dans les TD, les bibliothèques et les chambres d'étudiant à 2 h du matin. J'ai voulu documenter ce fossé avec des chiffres, des témoignages et surtout : sans prendre parti pour ou contre l'IA.

J'interviens depuis plusieurs années dans l'enseignement supérieur. Je forme des étudiants, j'échange avec des collègues enseignants, je vois ce qui se passe dans les amphis et dans les couloirs. Les enseignants sont pris en étau : sommés d'innover, sommés de contrôler, rarement formés sérieusement.

Beaucoup bricolent, testent, doutent. Certains interdisent par réflexe. D'autres autorisent sans vraiment savoir quoi surveiller.

La plupart oscillent entre les deux, avec cette impression diffuse que quelque chose leur échappe.

Pourquoi ce livre blanc sort maintenant

J'ai lancé cette enquête parce que je voyais trois signaux faibles devenir des signaux d'alarme :

L'IA n'est plus une expérimentation de geek, c'est un outil quotidien pour une majorité d'étudiants. Pas « quelques early adopters ». Pas « les étudiants en informatique ». Une majorité, toutes filières confondues. Et souvent utilisé hors de tout cadre explicite, dans une zone grise où personne ne dit vraiment ce qui est acceptable ou non.

Les établissements publient des chartes, mais j'observe un décalage énorme entre ce qui est écrit et ce qui se passe réellement. Les chartes parlent d'« usage responsable », de « citation des sources », d'« esprit critique ». Sur le terrain, les étudiants me confient qu'ils ne savent pas vraiment où placer le curseur. Et surtout : qu'ils ne l'assument pas devant leurs profs.

Les enseignants sont dans le flou. Certains surestiment l'usage de l'IA par leurs élèves. D'autres le sous-estiment. Beaucoup me disent qu'ils aimeraient avoir des repères concrets, pas juste des principes généraux. Ils veulent savoir ce qui se passe vraiment, pas ce qu'on leur raconte dans les réunions pédagogiques.

Ce livre blanc ne cherche pas à « vendre l'IA ». Il met à plat les usages, les risques et surtout ce qui s'atrophie quand on s'en remet trop facilement aux modèles.

Parce que c'est ça, le vrai sujet : pas « est-ce que l'IA est bien ou mal », mais « qu'est-ce qui se perd en silence pendant qu'on débat » ?

Tl;DR.

Ce que j'ai voulu mesurer

J'ai interrogé 291 étudiants et 254 enseignants. Toutes filières confondues : droit, commerce, ingénierie, sciences humaines, design. J'ai posé des questions simples, directes, parfois inconfortables. Et j'ai croisé les réponses pour voir où se situaient les décalages.

Voici les questions que j'ai explorées (les réponses chiffrées sont dans le livre blanc) :

- À partir de quel moment l'IA cesse d'être un outil d'apprentissage pour devenir une prothèse cognitive qui remplace l'effort ?

- Comment les étudiants perçoivent-ils réellement leurs compétences après deux ans d'usage intensif d'outils comme ChatGPT ou Claude ?

- Est-ce que les enseignants surestiment ou sous-estiment l'usage de l'IA par leurs élèves ?

- Quelles sont les compétences qui semblent se renforcer avec l'IA… et lesquelles se dégradent silencieusement ?

- Qu'est-ce qu'une politique d'établissement « claire » sur l'IA en 2025… et pourquoi ça ne suffit pas ?

Ce que j'ai découvert, c'est que le problème n'est pas l'IA. C'est le silence qui l'entoure. Les étudiants utilisent l'IA massivement, mais ne l'assument pas. Les enseignants savent que ça se passe, mais ne savent pas comment réagir. Les directions veulent encadrer, mais leurs chartes restent des vœux pieux.

Et pendant ce temps, certaines compétences fondamentales s'érodent. Sans bruit. Sans alerte. Juste un glissement progressif dont on ne mesurera les conséquences que dans quelques années.

Ce que vous ne trouverez pas dans ce livre blanc

Avant de vous dire ce qu'il contient, je préfère préciser ce qu'il ne contient pas.

Parce que ça dit beaucoup sur ma démarche.

Pas de promesse du type « l'IA va sauver l'école ». Je ne crois pas au techno-solutionnisme. L'IA n'est ni un problème ni une solution en soi. C'est un outil, et comme tout outil, il amplifie ce qu'on fait avec. Si la pédagogie est bancale, l'IA ne la sauvera pas. Si elle est solide, l'IA peut devenir un levier intéressant.

Pas de posture de surplomb. Je ne suis pas là pour donner des leçons. Je suis intervenant pro, consultant, créatif technologique. Je bricole avec l'IA tous les jours dans mon travail. Je la teste, je la casse, je vois ce qu'elle fait bien et ce qu'elle fait mal. Ce livre blanc se nourrit de retours d'étudiants et d'enseignants qui bricolent aussi. On est tous dans le même bateau.

Pas de débat théorique sur « faut-il autoriser ou interdire l'IA ». Cette question ne m'intéresse pas. Elle est déjà tranchée par les faits : les étudiants utilisent l'IA, qu'on l'autorise ou non. La vraie question, c'est : comment on accompagne cet usage pour qu'il ne se fasse pas au détriment des apprentissages fondamentaux ?

Mon positionnement est simple : je fais dialoguer le terrain, les outils concrets et la stratégie. Je ne suis ni dans le camp des technophiles béats ni dans celui des technophobes inquiets. Je suis dans le camp de ceux qui veulent comprendre ce qui se passe vraiment, avec des données, pour prendre des décisions éclairées.

Pour qui ce livre blanc change vraiment quelque chose

J'ai écrit ce document pour trois profils précis. Si vous vous reconnaissez dans l'un d'eux, il va vous être utile.

Responsables pédagogiques et directions d'école. Vous avez publié une charte IA l'année dernière. Elle fait trois pages, elle parle de « responsabilité », d'« éthique », de « citation des sources ». Mais sur le terrain, vous sentez que ça ne colle pas. Les enseignants vous demandent des clarifications. Les étudiants ne savent pas vraiment ce qui est autorisé. Ce livre blanc vous donne des arguments, des chiffres et des scénarios concrets pour sortir des chartes génériques et poser un cadre qui colle vraiment aux usages.

Enseignants curieux mais lucides. Vous ne voulez pas interdire l'IA par principe, mais vous ne voulez pas non plus laisser faire n'importe quoi. Vous cherchez des repères concrets : qu'est-ce qui est vraiment problématique ? Qu'est-ce qui peut être formateur ? Comment évaluer sans tomber dans la parano ? Ce livre blanc vous propose des grilles de lecture, des indicateurs, des scénarios pédagogiques (y compris sur la résilience « sans IA »).

Étudiants critiques. Vous utilisez l'IA, mais vous vous posez des questions. Est-ce que vous êtes en train de perdre des compétences ? Est-ce que vous sauriez encore faire sans ? Est-ce que les profs s'en rendent compte ? Ce livre blanc met des mots sur ce qui se joue dans votre pratique réelle. Il vous aide à comprendre où vous gagnez… et où vous perdez.

J'ai pensé ce texte comme un outil de discussion interne. À lire seul, mais surtout à découper, annoter, débattre en équipe. Parce que le vrai changement ne viendra pas d'une énième charte venue d'en haut, mais de conversations honnêtes entre enseignants, entre étudiants, entre responsables pédagogiques.

Ce que révèle vraiment cette enquête

Je ne vais pas vous donner tous les chiffres ici (ils sont dans le livre blanc), mais je peux vous dire ce qu'ils révèlent globalement.

Il y a un décalage de 3,6x entre l'usage réel de l'IA par les étudiants et ce qu'ils en disent à leurs enseignants. Ce n'est pas un petit écart. C'est un fossé. Et ce fossé révèle une crise de confiance systémique.

Les étudiants utilisent l'IA massivement, mais ils la cachent. Pas par malveillance. Par prudence. Parce qu'ils ne savent pas si c'est autorisé, toléré, ou sanctionné. Parce que les règles ne sont pas claires. Parce que les enseignants eux-mêmes semblent hésiter.

Et pendant ce temps, certaines compétences s'atrophient. Rechercher de l'information. Structurer une pensée. Rédiger sans assistance. Une partie des étudiants le reconnaissent : ils ont « désappris » à faire seuls ce qu'ils faisaient avant. Ce n'est pas dramatique en soi. Mais c'est un signal.

J'ai identifié trois pièges critiques :

Le Dunning-Kruger inversé. Les étudiants qui utilisent beaucoup l'IA pensent qu'ils sont moins bons qu'ils ne le sont vraiment. Ils ont perdu confiance en leurs capacités propres. Ils ne savent plus ce qui vient d'eux et ce qui vient de l'IA.

L'atrophie cognitive silencieuse. Certaines compétences se dégradent sans qu'on s'en aperçoive. Les étudiants produisent des livrables qui ont l'air corrects, mais ils ne savent plus comment ils les ont construits. Ils deviennent dépendants de l'outil sans même s'en rendre compte.

La transparence-espérée. Les établissements publient des chartes, organisent des formations, communiquent sur leur « politique IA ». Mais sur le terrain, rien ne change vraiment. Les étudiants continuent d'utiliser l'IA en cachette. Les enseignants continuent de corriger des copies sans savoir si elles ont été rédigées avec assistance. Et tout le monde fait semblant que ça va.

En bref.

Si vous êtes encore en train de débattre entre « interdire » et « tout autoriser », ce livre blanc n'est pas pour vous.

Si vous voulez comprendre ce que l'IA fait déjà aux compétences, à la confiance et à la relation pédagogique, alors téléchargez-le 😎

Je ne promets pas que ce sera facile. Je ne promets pas que ce sera confortable. Mais je vous garantis que ce sera plus honnête que de continuer à faire semblant que tout va bien.